蒸馏模型的基本原理与应用解析-人工智能中知识提炼的方法与实践

蒸馏模型的基本原理与应用解析-人工智能中知识提炼的方法与实践,是近年来深度学习领域的一项重要研究内容。该方法通过模拟知识传递的过程,实现从大型复杂模型到小型高效模型的转换,从而在降低模型复杂性的同时,保留原有模型的性能。本文将深入探讨蒸馏模型的基本原理,分析其在人工智能领域的应用,并探讨知识提炼的方法与实践。

一、蒸馏模型的基本原理

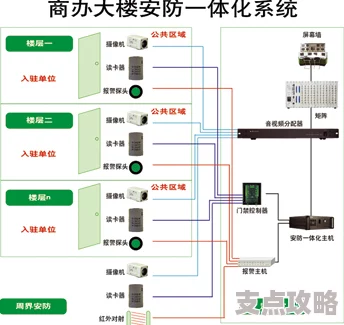

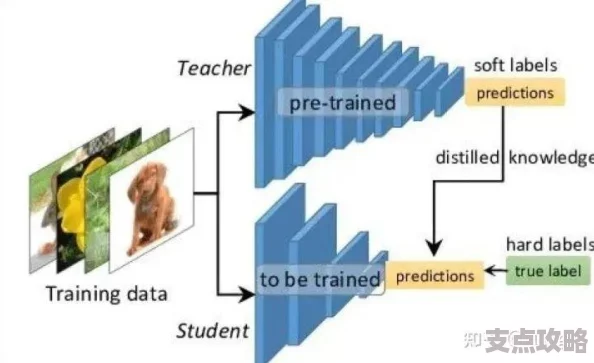

蒸馏模型的基本原理源于对知识传递的模拟。在深度学习中,大型复杂模型往往具有较好的性能,但参数众多、计算量大,难以在实际应用中部署。为了解决这个问题,研究者提出了蒸馏模型,将大型模型中的知识传递给小型模型,使其在保持性能的同时,降低复杂性和计算量。

蒸馏模型主要包括两个阶段:教师模型的训练和学生模型的训练。在教师模型训练阶段,先对大型模型进行训练,得到一个具有较高性能的模型。然后,在学生模型训练阶段,通过优化损失函数,使小型模型在保持原有性能的基础上,学习到教师模型中的知识。

二、蒸馏模型的应用解析

1. 模型压缩与部署

蒸馏模型在模型压缩与部署方面具有显著优势。通过将大型模型的知识传递给小型模型,可以在降低模型复杂性的同时,保持原有性能。这种方法在移动设备、嵌入式设备等资源受限的场景中具有广泛的应用前景。

2. 跨领域知识迁移

蒸馏模型还可以实现跨领域知识迁移。在多个相关领域之间,可以通过蒸馏模型将一个领域的知识传递给另一个领域,从而提高跨领域模型的性能。

3. 模型泛化能力提升

通过蒸馏模型,可以将多个模型的优点整合到一个模型中,提高模型的泛化能力。这种方法在多模型融合、多任务学习等领域具有重要作用。

三、知识提炼的方法与实践

1. 特征选择与降维

在知识提炼过程中,特征选择与降维是关键步骤。通过对原始特征进行筛选和降维,可以提取出更具代表性的特征,从而提高模型的性能。

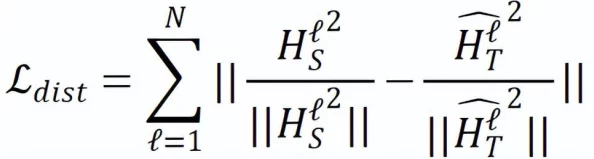

2. 知识蒸馏策略

知识蒸馏策略的选择对蒸馏模型的效果具有重要影响。常见的知识蒸馏策略包括温度调节、注意力机制等。通过合理选择知识蒸馏策略,可以提高知识传递的效果。

3. 模型融合与优化

在知识提炼过程中,模型融合与优化是提高模型性能的关键。通过将多个模型进行融合,并结合优化算法,可以进一步提高模型的性能。

四、相关问题探讨

1. 蒸馏模型在处理高维数据时,如何提高知识传递的效果?

答:在处理高维数据时,可以采用特征选择与降维方法,提取出更具代表性的特征。同时,可以尝试使用多种知识蒸馏策略,如温度调节、注意力机制等,以提高知识传递的效果。

2. 如何在保证模型性能的同时,降低蒸馏模型的计算量?

答:可以通过优化模型结构、减少参数数量、使用低精度数值等方法,降低蒸馏模型的计算量。此外,还可以通过模型剪枝、权值共享等技术,进一步提高模型的计算效率。

3. 蒸馏模型在跨领域知识迁移中,如何提高迁移效果?

答:在跨领域知识迁移中,可以采用以下方法提高迁移效果:选择具有相似特征的领域进行迁移;使用对抗性训练、领域自适应等技术,减少领域间的差异;结合多个领域的数据,进行多任务学习。